2026년 4월 30일 오후 3시 30분(EDT)에 게시됨

기술 출판 분야에서 Afam의 경험은 Make Tech Easier에서 근무했던 2018년으로 거슬러 올라갑니다. 수년에 걸쳐 그는 Windows, Linux 및 오픈 소스 도구를 다루는 고품질 가이드, 리뷰, 팁 및 설명 기사를 게시하는 것으로 명성을 쌓아왔습니다. 그의 작업은 Technical Ustad, Windows Report, Guiding Tech, Alphr 및 Next of Windows를 포함한 최고의 웹사이트에 소개되었습니다.

그는 컴퓨터 공학 1학위를 보유하고 있으며 Fuzo Tech YouTube 채널에 게시된 주제에 대한 몇 가지 팁, 비디오 및 튜토리얼을 통해 데이터 개인 정보 보호 및 보안에 대한 강력한 옹호자입니다.

그는 일하지 않을 때 가족과 함께 시간을 보내거나 자전거를 타거나 정원을 가꾸는 것을 좋아합니다.

Windows에서 로컬 LLM을 실행하는 것이 이렇게 어려울 것이라고는 전혀 생각하지 못했습니다. 괜찮아 보였지만 나중에 인스턴스가 전적으로 내 CPU에서 실행되고 있다는 것을 깨달았습니다. Ollama 모델을 가져온 후 드라이버, 환경 변수를 구성하고 결국 WSL2를 설정하는 것은 별도의 프로젝트처럼 느껴졌습니다. 그 후에는 스택을 유지하는 것이 매우 지치는 일이라는 것을 알게 되었습니다.

Linux에서 시도했을 때 나는 기분 좋게 놀랐습니다. 프로세스는 더 직접적이고 쉬웠으며 솔직히 더 이상 문제가 발생할 것이라고 예상하지 못했습니다. Linux 터미널을 로컬 AI 비서로 전환했을 때와 비슷한 느낌이었습니다.

10분 정도 걸렸어야 하는 설정

Windows의 Ollama가 계속 사용자를 끌어들이는 이유

Windows에서 Ollama를 설정하는 과정은 간단해 보일 수 있지만 실제로는 설치 프로그램을 다운로드하고 실행하는 것 이상의 작업을 수행합니다. 첫 번째 실행에서는 문자와 응답을 받게 되므로 모든 것이 완벽하다고 확신할 수 있습니다. 그러나 ollama ps 명령으로 확인합니다. , 유휴 GPU를 보여줍니다. 이는 CPU에서 실행되고 초당 3~5개의 토큰이 예상보다 상당히 느리기 때문입니다.

Ollama의 기본 자동 대체는 일반적이며 오류를 발생시키지 않기 때문에 발견하기 어렵습니다. 이 동작은 사용 가능한 VRAM이 모델에 비해 너무 작은 경우 다른 OS에서 가능합니다. 그러나 Windows에서는 드라이버/설치 프로그램 경쟁 조건, 환경 변수 전파 및 경쟁적인 리소스 사용과 같은 여러 다른 요인으로 인해 발생할 수 있습니다.

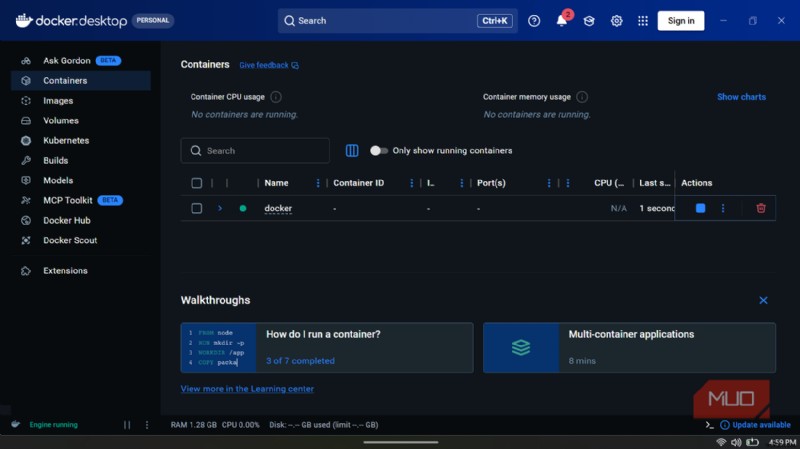

아무 것도 이상해 보이지 않더라도 여전히 실패할 수 있습니다. 이러한 경우 WSL2로 전환할 수 있습니다. 저는 Docker를 통해 Open WebUI를 사용해 보았습니다. Ollama는 브라우저 기반 서비스임에도 불구하고 로컬 ChatGPT처럼 느껴집니다. 그러나 Docker는 WSL2의 Windows에서 가장 안정적으로 실행됩니다. 이는 Windows 내에서 실행되는 Linux 환경이므로 복잡한 문제가 발생하지 않도록 주의 깊게 구성해야 합니다.

물론 최종적으로는 제대로 해낼 수 있을 것입니다. 그러나 작은 문제는 이 프로세스가 실제로 완료된 것처럼 느껴지지 않는다는 것입니다. 한 가지를 고치고, 또 다른 것을 고치고, 또 다른 것을 고치는 순환입니다. 작업 설정을 완료하는 데 시간이 얼마나 걸릴지 예측할 수 없습니다. 5분일 수도 있고 5시간일 수도 있습니다.

관련

관련

대부분의 시스템 문제를 해결하는 5가지 Linux 터미널 명령

모든 사용자가 알아야 할 필수 Linux 문제 해결 명령.

Linux 설치의 실제 모습

명령 하나, GPU 활성, 구성할 항목 없음

이에 비해 Linux에 로컬 LLM을 설치하는 것은 별 일 없었습니다. 하나의 설치 명령에서 모델 다운로드로 이동했고, GPU가 감지되었습니다. 그게 전부였습니다. 첫 번째 응답을 생성했을 때 수정할 부분이 있을 경우를 대비해 주변을 둘러보았습니다. 없었습니다.

이것은 어떤 OS가 더 나은지에 대한 질문이 아닙니다. Ollama의 설치 스크립트는 Linux용으로 처음 작성되었으며 바이너리 설치 및 Ollama를 시스템에서 시작하는 백그라운드 서비스로 등록하는 것부터 GPU 하드웨어를 자동으로 감지하는 것까지 거의 완벽하게 작동했다는 사실이었습니다. 이 중 어느 것도 브리징 레이어나 환경 변환이 필요하지 않습니다. 설치하기 전에 모든 드라이버가 준비되어 있으면 전체 프로세스가 자동으로 처리됩니다.

드라이버가 확인되기 전에 설치하여 GPU 감지에 실패하는 경우 Ollama를 다시 설치하여 문제를 해결하세요.

내 경험에 따르면 두 OS의 프로세스를 비교하면 다음과 같습니다.

<머리> <일>단계

<일>윈도우

<일>리눅스

올라마 설치

.exe 인스톨러(GPU 사용시 별도 확인 필요)

하나의 명령(GPU가 자동으로 감지됨)

실제로 첫 실행에 사용된 GPU

자동으로 CPU로 돌아가는 경우가 많습니다

운전자가 있는 경우 즉시 사용

WebUI 설정 열기

WSL2가 설치되어 있고 내부에 Docker가 구성되어 있어야 합니다.

단일 Docker 명령

AMD GPU 가속

실험적(ROCm v6.1+, 빈번한 CPU 대체 보고)

ROCm v7을 통한 완벽한 지원

Ollama는 시작 시 실행됩니다

수동 구성 필요

systemd를 통한 자동

Windows가 지원됩니다. Linux가 작성된 곳입니다.

생태계에 충분히 오래 머무르면 Ollama, Open WebUI 및 Docker가 Windows용으로 구축되지 않았으며 이를 기반으로 Python 통합이 구축되지 않았다는 것을 알게 됩니다. Windows 지원이 그 위에 놓여 있으며 이는 상당한 차이를 만듭니다.

가장 좋은 예는 Linux의 단일 Docker 명령인 Open WebUI입니다. 이 명령은 브라우저를 여는 동안 Ollama의 로컬 인스턴스에 연결하는 컨테이너를 즉시 시작합니다. Windows에서는 이러한 모든 요소를 구성합니다. 작동하지만 첫 번째 시도에서는 작동하지 않는 경우가 많으므로 일반적으로 디버깅 프로세스가 길어집니다.

이러한 문제는 AMD GPU 사용자에게는 훨씬 더 복잡합니다. GPU 추론을 위한 AMD의 컴퓨팅 플랫폼인 ROCm 버전 7에 대한 완전한 Linux 지원이 있습니다. Windows의 공식 지원은 버전 6.1 이상에서 중단되며 아직 실험적입니다. 결과적으로 AMD GPU를 사용하는 많은 Windows 사용자는 하드웨어 성능에 관계없이 여전히 CPU에서 Ollama를 실행합니다. 기본 GPU 스택을 사용할 수 없습니다.

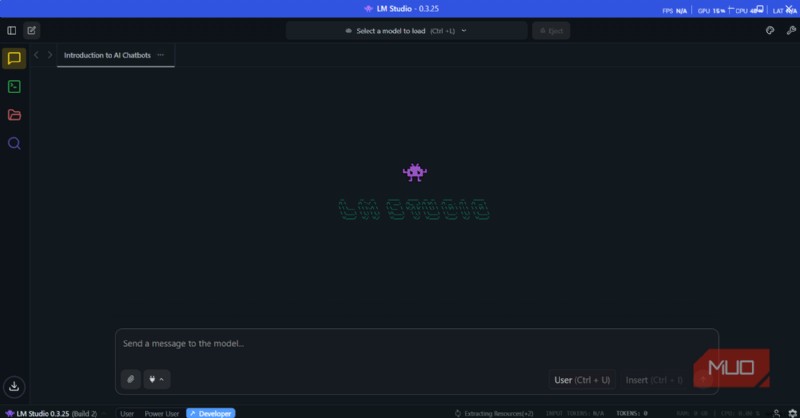

Ollama와 별도의 도구로 LM Studio를 사용하는 것을 고려해 보세요. GUI 우선이며 Windows 및 Linux에서 깔끔하게 실행되며 터미널 없이 모델을 실행할 수 있습니다. 그러나 더 많은 작업을 수행하지 않고 현지 LLM과 채팅하려는 경우에만 작동합니다.

절약한 시간은 선불이 아닙니다

초기 설치가 매우 유동적이라는 것을 알았지만 이후 설정을 사용할 때마다 로컬 LLM이 Linux에서 어떻게 더 잘 작동하는지 알게 되었습니다. 그 이유는 한번 설치해서 영원히 계속 사용하는 것이 아니기 때문입니다. 새로운 모델이 출시되면 계속해서 사용해 보세요. 모델이 너무 느려지면서 지속적으로 더 작고 양자화된 버전을 시도하고 있습니다.

이 모든 것에는 시스템 수준의 변경이 필요합니다. 변경을 하면 Windows의 초기 문제가 다시 발생할 수 있으며, 이는 로컬 LLM 경험을 매우 불쾌하게 만들 뿐입니다.

로컬 LLM을 위해 Linux를 사용해 보고 싶다면 Linux Mint를 사용하는 것이 좋습니다. 아마도 Windows 생태계에 참여하는 모든 사람에게 최고의 배포판일 것입니다.

운영체제 리눅스

최소 CPU 사양 64비트 단일 코어

최소 RAM 사양 1.5GB

Linux Mint는 데스크톱 및 노트북을 위한 널리 사용되는 무료 오픈 소스 운영 체제입니다. 사용자 친화적이고 안정적이며 기본적으로 기능적입니다.